Биномиальное распределение

Материал из MachineLearning.

м (Отмена правки № 25799 участника Vitsemgol (обсуждение) доказательства теорем содержат грубые ошибки) |

(→Пример) |

||

| Строка 107: | Строка 107: | ||

Ошибка приближения равна <tex>0.0022</tex> — примерно в 5 раз меньше, чем в предыдущем подходе. | Ошибка приближения равна <tex>0.0022</tex> — примерно в 5 раз меньше, чем в предыдущем подходе. | ||

| + | |||

| + | == Постулаты и их ложность == | ||

| + | |||

| + | Биномиальное распределение традиционной интерпретации | ||

| + | основано на трёх [[постулат |постулатах]] [2] | ||

| + | |||

| + | *Биномиальное распределение — распределение '''одной''' случайной величины; | ||

| + | *Биномиальное распределение появляется в последовательности '''независимых''' испытаний (экспериментов); | ||

| + | *Математическое ожидание биномиального распределения '''равно''' <tex>np</tex> , где <tex>n</tex> - конечное число независимых испытаний с двумя взаимно исключающими исходами каждое: положительный исход 1 c вероятностью <tex>p</tex> и отрицательный исход 0 с вероятностью <tex>q=1-p</tex>. | ||

| + | |||

| + | Ложность постулатов доказывается двумя теоремами[3,4]. | ||

| + | |||

| + | '''Теорема 1. ''' Биномиальное распределение не является распределением одной случайной величины. | ||

| + | |||

| + | '''Доказательство. ''' | ||

| + | |||

| + | Если энциклопедически известно известно , что биномиальное распределение является частным случаем традиционной интерпретации полиномиального распределения как совместного распределения вероятностей независимых <tex>X_1,\ldots, X _k</tex> случайных величин при сокращении в нём числа <tex>k</tex> случайных величин до двух, то подставляя условие <tex>k=2</tex> в формулу традиционной интерпретации полиномиального распределения | ||

| + | |||

| + | ::<tex>P(X_1=n_1,\ldots,X_k=n_k)= \frac{n!}{n_1!\cdots n_k!}p_1^{n_1}\cdots p_k^{n_k},</tex> | ||

| + | |||

| + | ::<tex>2\le k \le n< \infty, \quad n_1+\ldots+n_k=n, \quad p_1+\ldots+p_k=1, \quad i=1,\ldots,k, </tex> | ||

| + | |||

| + | получим формулу биномиального распределения не одной случайной величины, а '''двух''' случайных величин | ||

| + | |||

| + | ::<tex> P(X_1=n_1, X_2=n_2)= \frac{n!}{n_1! n_2!} p_1^{n_1}p_2^{n_2}, </tex> | ||

| + | |||

| + | ::<tex>2\le k \le n< \infty, \quad n_1+n_2=n, \quad p_1+p_2=1,</tex> | ||

| + | |||

| + | что и требовалось доказать. | ||

| + | |||

| + | Примечание. | ||

| + | Характер зависимости второй случайной величины от первой описан ниже. | ||

| + | |||

| + | '''Доказательство ложности второго и третьего постулатов.''' | ||

| + | |||

| + | '''Теорема 2.''' ''Биномиальное распределение не появляется в последовательности независимых испытаний (экспериментов) и его математическое ожидание'' '''не равно''' <tex>np</tex> . | ||

| + | |||

| + | '''Доказательство.''' | ||

| + | |||

| + | Допустим, что | ||

| + | |||

| + | ::<tex>np </tex> | ||

| + | |||

| + | математическое ожидание биномиального распределения, появляющегося в последовательности независимых испытаний (экспериментов). Тогда при выполнении условия | ||

| + | |||

| + | ::<tex>n>p^{-1}</tex> | ||

| + | |||

| + | математическое ожидание этого распределения будет больше единицы, что противоречит [[аксиоматика Колмогорова | аксиоматике Колмогорова]], согласно которой сумма всех вероятностей распределения, включая и его математическое ожидание, должна быть равной единице. | ||

| + | |||

| + | |||

| + | Теорема 2 доказана. | ||

==Литература== | ==Литература== | ||

Версия 10:15, 20 декабря 2012

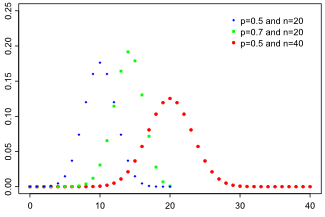

Функция вероятности

| |

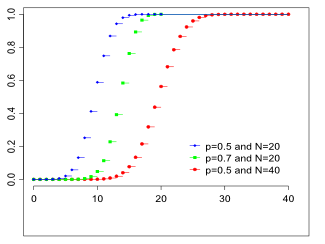

Функция распределения

| |

| Параметры | |

| Носитель | |

| Функция вероятности | |

| Функция распределения | |

| Математическое ожидание | |

| Медиана | одно из |

| Мода | |

| Дисперсия | |

| Коэффициент асимметрии | |

| Коэффициент эксцесса | |

| Информационная энтропия | |

| Производящая функция моментов | |

| Характеристическая функция | |

Содержание |

Определение

Биномиальное распределение — дискретное распределение вероятностей случайной величины принимающей целочисленные значения

с вероятностями:

Данное распределение характеризуется двумя параметрами: целым числом называемым числом испытаний, и вещественным числом

называемом вероятностью успеха в одном испытании. Биномиальное распределение — одно из основных распределений вероятностей, связанных с последовательностью независимых испытаний. Если проводится серия из

независимых испытаний, в каждом из которых может произойти "успех" с вероятностью

то случайная величина, равная числу успехов во всей серии, имеет указанное распределение. Эта величина также может быть представлена в виде суммы

независимых слагаемых, имеющих распределение Бернулли.

Основные свойства

- Математическое ожидание:

- Дисперсия:

- Асимметрия:

при

распределение симметрично относительно центра

Асимптотические приближения при больших

Если значения велики, то непосредственное вычисление вероятностей событий, связанных с данной случайной величиной, технически затруднительно.

В этих случаях можно использовать приближения биномиального распределения распределением Пуассона и нормальным (приближение Муавра-Лапласа).

Приближение Пуассона

Приближение распределением Пуассона применяется в ситуациях, когда значения большие, а значения

близки к нулю. При этом биномиальное распределение аппроксимируется распределением Пуассона с параметром

Строгая формулировка: если и

таким образом, что

то

Более того, справедлива следующая оценка. Пусть — случайная величина, имеющая распределение Пуассона с параметром

Тогда для произвольного множества

справедливо неравенство:

Доказательство и обзор более точных результатов, касающихся точности данного приближения, можно найти в [1, гл. III, §12].

Нормальное приближение

Приближение нормальным распределением используется в ситуациях, когда а

фиксировано. Это приближение можно рассматривать как частный случай центральной предельной теоремы, применение которой основано на представлении

в виде суммы

слагаемых. Приближение основано на том, что при указанных условиях распределение нормированной величины

где

близко к стандартному нормальному.

Локальная теорема Муавра-Лапласа

Данная теорема используется для приближенного вычисления вероятностей отдельных значений биномиального распределения. Она утверждает [1, гл. I, §6], что равномерно по всем значениям таким что

имеет место

где — плотность стандартного нормального распределения.

Интегральная теорема Муавра-Лапласа

На практике необходимость оценки вероятностей отдельных значений, которую дает локальная теорема Муавра-Лапласа, возникает нечасто. Гораздо более важно оценивать вероятности событий, включающих в себя множество значений. Для этого используется интегральная теорема, которую можно сформулировать в следующем виде [1, гл. I, §6]:

при

где случайная величина имеет стандартное нормальное распределение

и аппроксимирующая вероятность определяется по формуле

где — функция распределения стандартного нормального закона:

Есть ряд результатов, позволяющих оценить скорость сходимости. В [1, гл. I, §6] приводится следующий результат, являющийся частным случаем теоремы Берри-Эссеена:

где — функция распределения случайной величины

На практике решение о том, насколько следует доверять нормальному приближению, принимают исходя из величины

Чем она больше, тем меньше будет погрешность приближения.

Заметим, что асимптотический результат не изменится, если заменить строгие неравенства на нестрогие и наоборот. Предельная вероятность от такой замены также не поменяется, так как нормальное распределение абсолютно непрерывно и вероятность принять любое конкретное значение для него равна нулю. Однако исходная вероятность от такой замены может измениться, что вносит в формулу некоторую неоднозначность. Для больших значений изменение будет невелико, однако для небольших

это может внести дополнительную погрешность.

Для устранения этой неоднозначности, а также повышения точности приближения рекомендуется задавать интересующие события в виде интервалов с полуцелыми границами. При этом приближение получается точнее. Это связано с тем интуитивно понятным соображением, что аппроксимация кусочно-постоянной функции (функции распределения биномиального закона) с помощью непрерывной функции дает более точные приближения между точками разрыва, чем в этих точках.

Пример

Пусть

Оценим вероятность того, что число успехов будет отличаться от наиболее вероятного значения

не более чем на

. Заметим, что значение

очень мало, поэтому применение нормального приближения здесь довольно ненадежно.

Точная вероятность рассматриваемого события равна

Применим нормальное приближение с той расстановкой неравенств, которая дана выше (снизу строгое, сверху нестрогое):

Ошибка приближения равна .

Теперь построим приближение, используя интервал с концами в полуцелых точках:

Ошибка приближения равна — примерно в 5 раз меньше, чем в предыдущем подходе.

Постулаты и их ложность

Биномиальное распределение традиционной интерпретации основано на трёх постулатах [2]

- Биномиальное распределение — распределение одной случайной величины;

- Биномиальное распределение появляется в последовательности независимых испытаний (экспериментов);

- Математическое ожидание биномиального распределения равно

, где

- конечное число независимых испытаний с двумя взаимно исключающими исходами каждое: положительный исход 1 c вероятностью

и отрицательный исход 0 с вероятностью

.

Ложность постулатов доказывается двумя теоремами[3,4].

Теорема 1. Биномиальное распределение не является распределением одной случайной величины.

Доказательство.

Если энциклопедически известно известно , что биномиальное распределение является частным случаем традиционной интерпретации полиномиального распределения как совместного распределения вероятностей независимых случайных величин при сокращении в нём числа

случайных величин до двух, то подставляя условие

в формулу традиционной интерпретации полиномиального распределения

получим формулу биномиального распределения не одной случайной величины, а двух случайных величин

что и требовалось доказать.

Примечание. Характер зависимости второй случайной величины от первой описан ниже.

Доказательство ложности второго и третьего постулатов.

Теорема 2. Биномиальное распределение не появляется в последовательности независимых испытаний (экспериментов) и его математическое ожидание не равно .

Доказательство.

Допустим, что

математическое ожидание биномиального распределения, появляющегося в последовательности независимых испытаний (экспериментов). Тогда при выполнении условия

математическое ожидание этого распределения будет больше единицы, что противоречит аксиоматике Колмогорова, согласно которой сумма всех вероятностей распределения, включая и его математическое ожидание, должна быть равной единице.

Теорема 2 доказана.

Литература

1. Ширяев А.Н. Вероятность. — М.: МЦНМО, 2004.

Ссылки

- Биномиальное распределение (Википедия)

- Binomial distribution (Wikipedia)