Аппроксимация Лапласа (пример)

Материал из MachineLearning.

(→Пример 1) |

(→Пример 1) |

||

| Строка 38: | Строка 38: | ||

[[Изображение:Sse(w1,w2)_laplas.png|center|frame|Laplace approximation]] | [[Изображение:Sse(w1,w2)_laplas.png|center|frame|Laplace approximation]] | ||

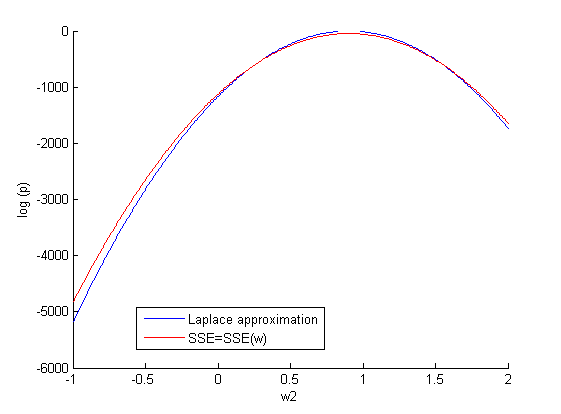

| - | <tex>D_{kl}(p_{SSE},p_{lap})=1. | + | <tex>D_{kl}(p_{SSE},p_{lap})=1.2481</tex> |

На рис.2 наблюдается зависимость между коэффициентами <tex>w_1</tex> и <tex>w_2</tex>. Следовательно, ковариационная матрица cov(w_1,w_2) не будет диагональной. | На рис.2 наблюдается зависимость между коэффициентами <tex>w_1</tex> и <tex>w_2</tex>. Следовательно, ковариационная матрица cov(w_1,w_2) не будет диагональной. | ||

Версия 23:19, 16 ноября 2010

Аппроксимация Лапласа - простой, но широко используемый способ нахождения нормального (Гауссово) распределения для апроксимации заданой плотности вероятности.

Содержание |

Сэмплирование

Сэмплирование – процесс выбора подмножества наблюдаемых величин из данного множества, для дальнейшего его анализа.

Одно из основных приминений методов сэмплирования заключается в оценке мат. ожидания сложных вероятностных распределений: , для которых тяжело делать выборку непосредственно из распределения p(z). Однако, можно подсчитать значение p(z) в любой точке z. Один из наиболее простых методов подсчета мат. ожидаия – разбить ось z на равномерную сетку и подсчитать интеграл как сумму

≅

. Существует несколько методов сэмплирования для создания подходящей выборки длинны L ???.

Постановка задачи

Задана выборка — множество значений свободных переменных и множество

соответствующих им значений зависимой переменной.

Необходимо для выбранной регрессионной модели

показать зависимость среднеквадратичной ошибки от значений параметров модели:

; построить график и сделать апроксимацию Лапласа для него; найти расстояния между получеными зависимостями, используя метрику Кульбака - Лейблера.

Описание алгоритма

метрика Кульбака - Лейблера:

Вычислительный эксперимент

Обозначим плоность распределения SSE как , а его апроксимация лапласса

Пример 1

Задуманная функция . Берем линейную регрессионную модель с 2-мя параметрами:

.

Используя МНК находим оптимальное значение

и

(при которых SSE минимально).

При фиксированном задаем различные значение

(500 рандомных значений на отрезке [-1;2]) и строим зависимость:

.

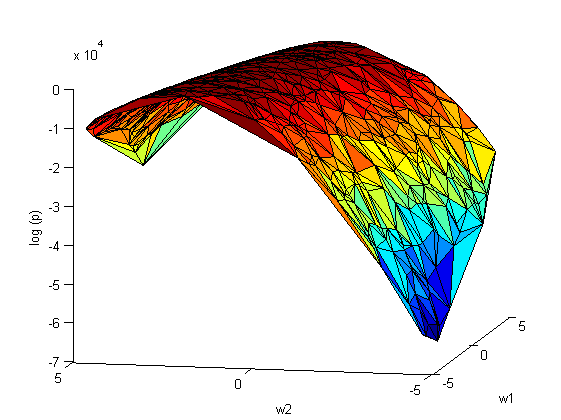

Повторим эксперимент, только теперь варируем сразу оба параметра и

:

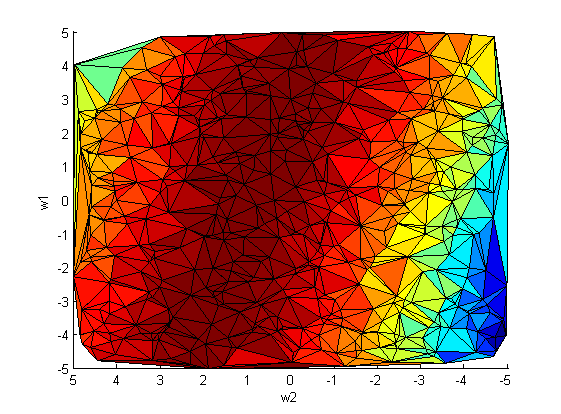

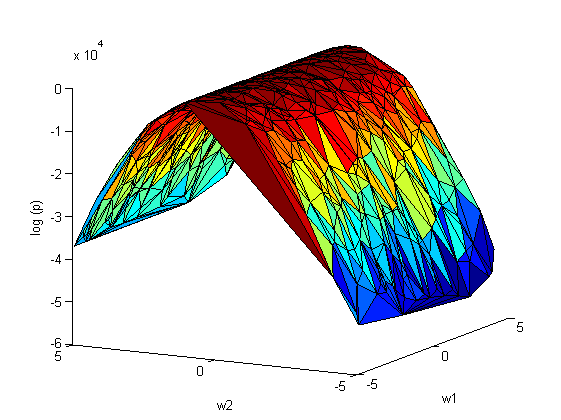

апроксимация лапласса:

На рис.2 наблюдается зависимость между коэффициентами и

. Следовательно, ковариационная матрица cov(w_1,w_2) не будет диагональной.