Статистический отчет при создании моделей

Материал из MachineLearning.

(→Вычислительный эксперимент) |

(→Вычислительный эксперимент) |

||

| Строка 65: | Строка 65: | ||

В данном отчете представлены результаты применения созданного инструмента для анализа модели. | В данном отчете представлены результаты применения созданного инструмента для анализа модели. | ||

Отчет состоит из трех экспериментов, демонстрирующих работу инструмента на различных по качеству моделях. | Отчет состоит из трех экспериментов, демонстрирующих работу инструмента на различных по качеству моделях. | ||

| - | |||

| - | |||

=== Модель №1 === | === Модель №1 === | ||

Версия 21:34, 14 ноября 2011

|

В данной работе приведен обзор статистических методов оценивания качества регрессионных моделей, используемых популярными программами машинного обучения и статистической обработки данных. Приведены примеры вычисления и анализа полученных оценок.

Постановка задачи

Имеется пространство объектов-строк и

пространство ответов

.

Задана выборка

.

Обозначеним:

-

— матрица информации или матрица плана;

-

— вектор параметров;

-

— целевой вектор.

Будем считать, что зависимость имеет вид

,

где — некоторая неслучайная функция,

— случайная величина,

с нулевым математически ожиданием.

В моделях многомерной линейной регрессии предполагается, что неслучайная составляющая имеет вид:

.

Требуется численно оценить качество модели при заданном векторе параметров .

Описание решения

Предполагая,

что матрица ковариации вектора ошибки имеет вид

,

где

,

получаем выражение для оценки параметров

взвешенным методом наименьших квадратов:

Основными инструментами оценки качества линейной модели является анализ:

- регрессионных остатков;

- матрицы частных и получастных корреляций (условные корреляции);

- корреляции и ковариации коэффициентов регрессии;

- статистики Дарбина-Уотсона;

- расстояния Махаланобиса между исходной и модельной зависимостями;

- расстояния Кука (мера изменения прогноза при удалении одного объекта);

- доверительных интервалов для предсказанных значений.

В работе рассматривается

- анализ регрессионных остатков, включающий в себя:

- вычисление среднеквадратичной ошибки:

- вычисление коэффициента детерминации:

где

- проверку гипотезы о равенстве нулю математического ожидания регрессионных остатков на основе критерия знаков;

- проверку гипотезы о равенстве дисперсий (пропорциональности с заданными коэффициентами) регрессионных остатков на основе критерия Ансари-Брэдли;

- проверку гипотезы о нормальности распределения регрессионных остатков на основе критерия хи-квадрат и критерия Жарка-Бера;

- вычисление расстояния Махаланобиса и Кука;

- вычисление корреляций признаков, корреляций признаков и значений моделируемой функции и коэффициента множественной регрессии.

Вычислительный эксперимент

В данном отчете представлены результаты применения созданного инструмента для анализа модели. Отчет состоит из трех экспериментов, демонстрирующих работу инструмента на различных по качеству моделях.

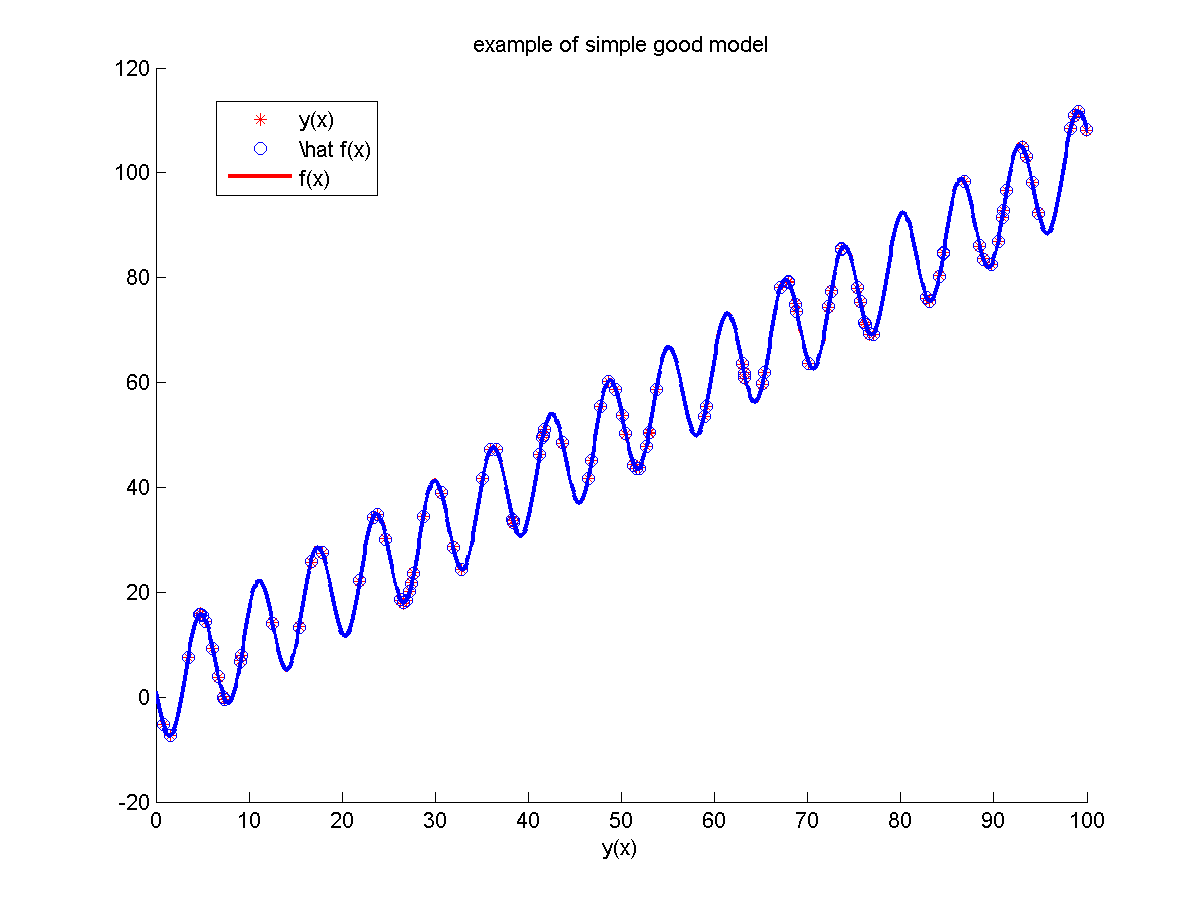

Модель №1

Неизвестная зависимость:

.

Для построения модели использовалось объектов независимо равномерно распределительных на отрезке

В качестве шума использовались независимые случайные величины из распределения

В качестве признаков использовались

.

Параметры модели подбирались с помощью метода наименьших квадратов.

Отчет, построенный программой:

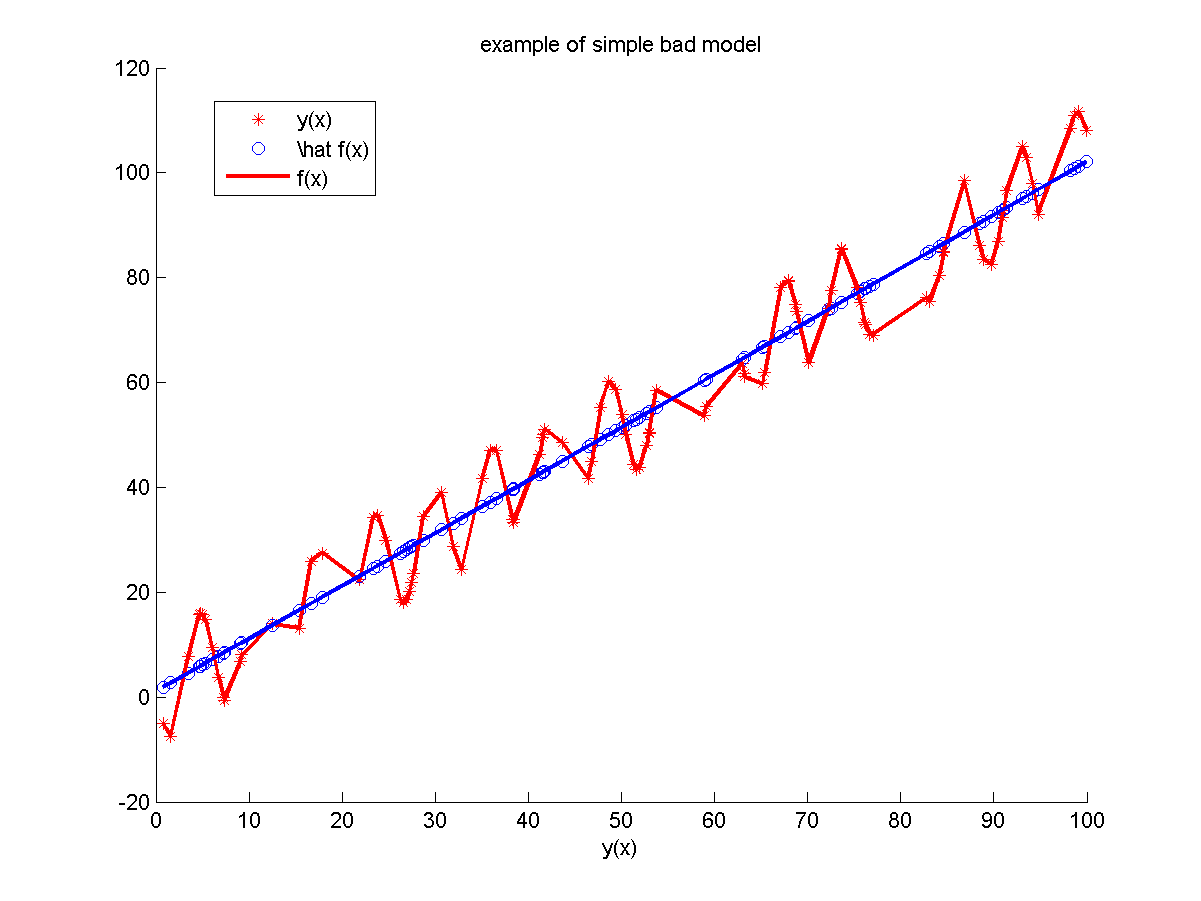

Модель №2

Неизвестная зависимость:

.

Для построения модели использовалось объектов независимо равномерно распределительных на отрезке

В качестве шума использовались независимые случайные величины из распределения

В качестве признаков использовались

.

Параметры модели подбирались с помощью метода наименьших квадратов.

Отчет, построенный программой:

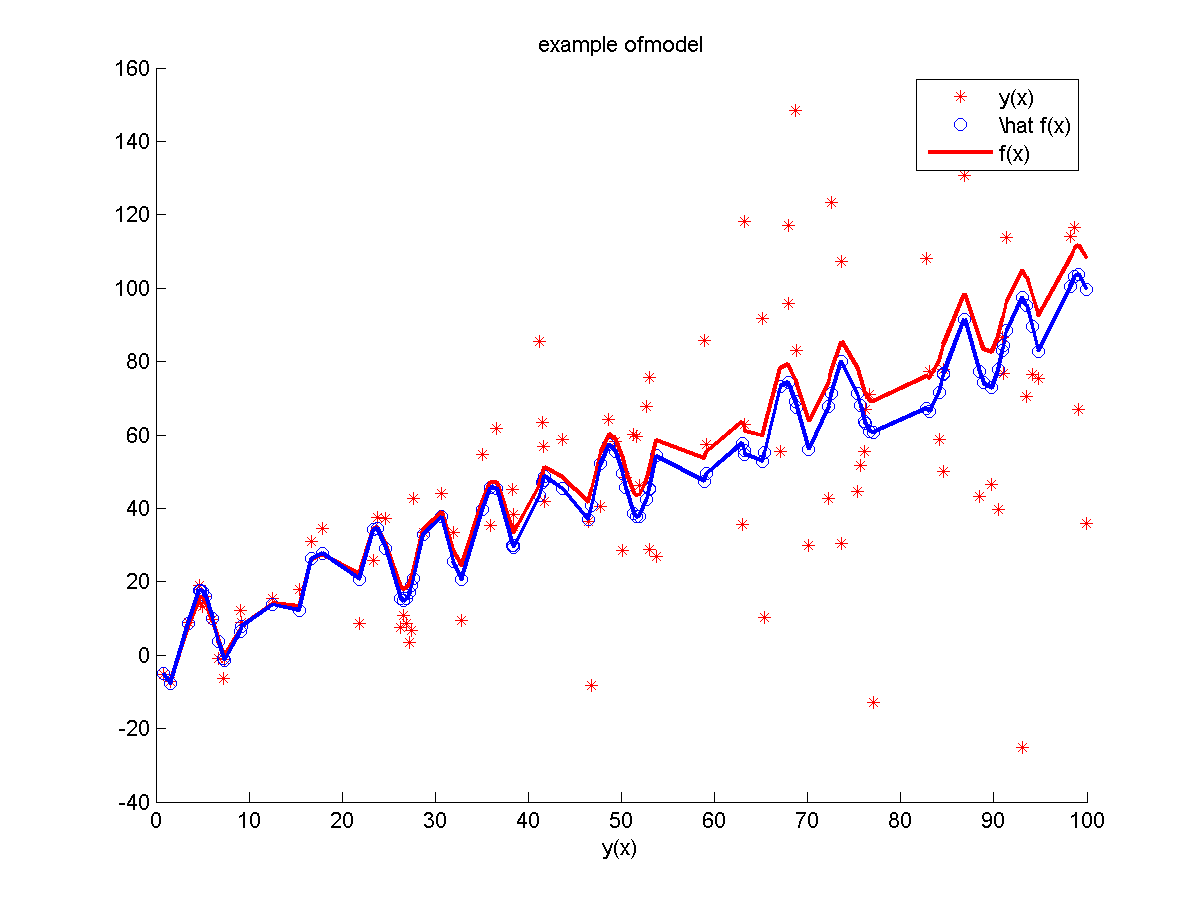

Модель №3

Неизвестная зависимость:

.

Для построения модели использовалось объектов независимо равномерно распределительных на отрезке

В качестве шума использовались независимые случайные величины из распределения

В качестве признаков использовались

.

Параметры модели подбирались с помощью метода наименьших квадратов.

Отчет, построенный программой:

Исходный код и полный текст работы

Функция, строящая отчет, и примеры.

Смотри также

Литература

- Bishop, C. Pattern Recognition And Machine Learning. Springer. 2006.

- Кобзарь А. И. Прикладная математическая статистика. — М.: Физматлит, 2006.

- Лагутин М. Б. Наглядная математическая статистика. В двух томах. — М.: П-центр, 2003.

| | Данная статья является непроверенным учебным заданием.

До указанного срока статья не должна редактироваться другими участниками проекта MachineLearning.ru. По его окончании любой участник вправе исправить данную статью по своему усмотрению и удалить данное предупреждение, выводимое с помощью шаблона {{Задание}}. См. также методические указания по использованию Ресурса MachineLearning.ru в учебном процессе. |