Коэффициент корреляции Пирсона

Материал из MachineLearning.

(Различия между версиями)

(→Слабые стороны) |

|||

| Строка 35: | Строка 35: | ||

* С помощью коэффициента корреляции можно определить линейную зависимость между величинами, другие взаимосвязи выявляются методами [[Регрессионный анализ|регрессионного анализа]]; | * С помощью коэффициента корреляции можно определить линейную зависимость между величинами, другие взаимосвязи выявляются методами [[Регрессионный анализ|регрессионного анализа]]; | ||

| - | * Необходимо понимать различие понятий "независимость" и "некоррелированность". Из первого следует второе, но не наоборот. Для того, чтобы выяснить отношение между двумя переменными, необходимо избавиться от влияния третьей переменной. Рассмотрим пример 3-х переменных: x,y,z. Исключим влияние переменной z: | + | * Необходимо понимать различие понятий "независимость" и "некоррелированность". Из первого следует второе, но не наоборот. |

| + | |||

| + | Для того, чтобы выяснить отношение между двумя переменными, часто необходимо избавиться от влияния третьей переменной. Рассмотрим пример 3-х переменных: x,y,z. Исключим влияние переменной z: | ||

:: <tex>r_{xy \setminus z}=\frac{r_{xy}-r_{xz}r_{yz}}{\sqrt{ \left(\ 1-r_{xz} \right)^2 \left(\ 1-r_{yz} \right)^2}} </tex> | :: <tex>r_{xy \setminus z}=\frac{r_{xy}-r_{xz}r_{yz}}{\sqrt{ \left(\ 1-r_{xz} \right)^2 \left(\ 1-r_{yz} \right)^2}} </tex> | ||

Версия 18:14, 8 января 2009

|

Определение

Коэффициент корреляции Пирсона характеризует существование линейной зависимости между двумя величинами.

Даны две выборки

;

Коэффициент корреляции Пирсена рассчитывается по формуле:

где

- средние значения выборок x и y;

- среднеквадратичные отклонения;

− называют также теснотой линейной связи.

, тогда

- линейно зависимы.

, тогда

- линейно независимы.

Статистическая проверка наличия корреляции

Гипотеза : Отсутствие линейной связи

Статистика критерия:

- Распределение Стьюдента с

степенями свободы.

Слабые стороны

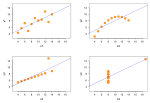

- Неустойчивость к выбросам;

- С помощью коэффициента корреляции можно определить линейную зависимость между величинами, другие взаимосвязи выявляются методами регрессионного анализа;

- Необходимо понимать различие понятий "независимость" и "некоррелированность". Из первого следует второе, но не наоборот.

Для того, чтобы выяснить отношение между двумя переменными, часто необходимо избавиться от влияния третьей переменной. Рассмотрим пример 3-х переменных: x,y,z. Исключим влияние переменной z:

Для исключения влияния большего числа переменных:

, где

- гл. минор матрицы коэффициентов корреляции переменных

;