Математические основы теории прогнозирования (курс лекций, Ю.И. Журавлев, Д.П. Ветров)/2011/Задание СФ

Материал из MachineLearning.

(→Рекомендации по выполнению задания) |

(+ картинки) |

||

| Строка 3: | Строка 3: | ||

{{TOCright|300px}} | {{TOCright|300px}} | ||

| - | [[Изображение: | + | {|align="left" |

| + | |-valign="bottom" | ||

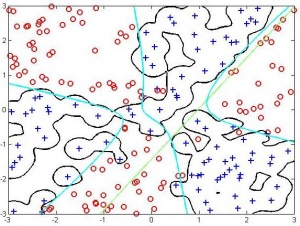

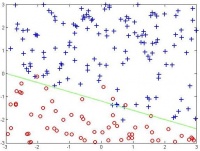

| + | |[[Изображение:MOTP11_wine.jpg|200px]] || rowspan="2"|[[Изображение:MOTP11_concrete.jpg|175px]] | ||

| + | |- | ||

| + | |[[Изображение:MOTP11_logreg.jpg|200px]] | ||

| + | |}<br clear="all" /> | ||

[[Математические основы теории прогнозирования (курс лекций, Ю.И. Журавлев, Д.П. Ветров)|Перейти к основной странице курса]] | [[Математические основы теории прогнозирования (курс лекций, Ю.И. Журавлев, Д.П. Ветров)|Перейти к основной странице курса]] | ||

| Строка 77: | Строка 82: | ||

Для выполнения задания необходимо выполнить следующие пункты: | Для выполнения задания необходимо выполнить следующие пункты: | ||

| - | {|style="background:# | + | {|style="background:#F0FFF0" |

|1. Реализовать процедуру обучения/тестирования/подбора структурных параметров линейной регрессии по описанному ниже прототипу; | |1. Реализовать процедуру обучения/тестирования/подбора структурных параметров линейной регрессии по описанному ниже прототипу; | ||

|- | |- | ||

| Строка 213: | Строка 218: | ||

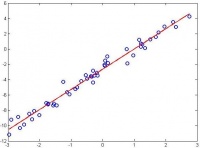

|[[Изображение:MOTP11_linreg_underoverfitting.jpg|мини|300px|Различные модели линейной регрессии. Зеленая кривая — недообучение, черная кривая — переобучение, голубая кривая — адекватная зависимость]] | |[[Изображение:MOTP11_linreg_underoverfitting.jpg|мини|300px|Различные модели линейной регрессии. Зеленая кривая — недообучение, черная кривая — переобучение, голубая кривая — адекватная зависимость]] | ||

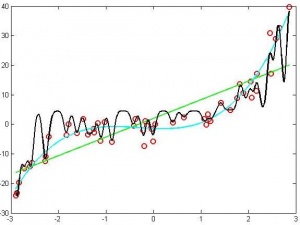

|[[Изображение:MOTP11_logreg_underoverfitting.jpg|мини|300px|Различные модели логистической регрессии. Зеленое решающее правило — недообучение, черное решающее правило — переобучение, голубое решающее правило — адекватная зависимость]] | |[[Изображение:MOTP11_logreg_underoverfitting.jpg|мини|300px|Различные модели логистической регрессии. Зеленое решающее правило — недообучение, черное решающее правило — переобучение, голубое решающее правило — адекватная зависимость]] | ||

| - | |} | + | |}<br clear="all" /> |

| + | |||

| + | [[Изображение:MOTP11_wine.jpg|200px]] | ||

| + | [[Изображение:MOTP11_concrete.jpg|175px]] | ||

=== Описание практических задач === | === Описание практических задач === | ||

Версия 18:21, 29 июня 2011

| | Текст задания находится в стадии формирования. Убедительная просьба не приступать к выполнению задания до тех пор, пока это сообщение не будет удалено. |

|

|

|

|

Перейти к основной странице курса

Срок сдачи задания: 1 сентября 2011, 23:59

Данное практическое задание предназначено в первую очередь для студентов Севастопольского филиала, которые имеют задолженность по курсу МОТП и не имеют возможности присутствовать в Москве на пересдачах осенью — Талалуева Кирилла, Пантелеева Ивана, Щербаткина Егора, Клименко Александра и Сребняка Ивана. Тем не менее, это задание могут выполнять и московские студенты ВМиК, которые имеют задолженность по курсу МОТП. Оценка за это задание будет итоговой оценкой по курсу МОТП.

Цель данного задания состоит в том, чтобы студенты познакомились на практике с простейшими методами решения задач регрессии и классификации — линейной и логистической регрессией соответственно, а также с базовыми аспектами, с которыми приходится сталкиваться при решении задач машинного обучения — проблемой переобучения и проблемой подбора структурных параметров алгоритмов (в данном случае в качестве таковых выступают коэффициенты регуляризации и параметры базисных функций).

Необходимая теория

Линейная регрессия

Рассматривается задача регрессии. Имеется обучающая выборка , где

— вектор признаков для объекта

, а

— значение его регрессионной переменной. Задача заключается в предсказании значения регрессионной переменной

для объекта, представленного своим вектором признаков

.

В линейной регрессии предсказание осуществляется с помощью линейной функции:

,

где — веса линейного решающего правила, а

— фиксированные базисные функции (новые признаки). Примеры базисных функций:

- Исходные признаки:

;

- Полиномиальные базисные функции:

— степень полинома;

- Радиальные базисные функции:

, где

, а

— некоторые заранее выбранные опорные объекты, например, объекты обучающей выборки.

Веса линейного решающего правила настраиваются с помощью минимизации регуляризованного критерия наименьших квадратов:

.

Здесь — задаваемый пользователем параметр регуляризации. Данный функционал может быть минимизирован аналитически:

.

Логистическая регрессия

Рассматривается задача классификации на два класса. Имеется обучающая выборка , где

— вектор признаков для объекта

, а

— его метка класса. Задача заключается в предсказании метки класса

для объекта, представленного своим вектором признаков

.

В логистической регрессии предсказание метки класса осуществляется по знаку линейной функции:

Здесь веса и базисные функции

вводятся аналогично случаю линейной регрессии. Веса

решающего правила настраиваются с помощью минимизации следующего регуляризованного критерия:

.

Здесь — задаваемый пользователем параметр регуляризации. Функционал

является выпуклой функцией относительно своих параметров

и поэтому может быть эффективно минимизирован с помощью любого итерационного метода безусловной оптимизации, учитывающего значения градиента и гессиана функции

, например, метода Ньютона.

Скользящий контроль

В алгоритмах линейной/логистической регрессии параметр регуляризации , а также параметры базисных функций (например, степень полинома или параметр

в радиальных базисных функциях) являются структурными параметрами, которые

не могут быть настроены путем минимизации критерия

на обучающей выборке. Для их настройки используются критерии выбора модели, например, скользящий контроль.

Обозначим через результат прогноза (значение регрессионной переменной или метки класса) для объекта

, полученный с помощью алгоритма

, обученного по выборке

.

При

-кратном скользящем контроле обучающая выборка

разбивается на

равных частей

. Общая величина ошибки на

-кратном скользящем контроле вычисляется как

.

Здесь через обозначена обучающая выборка без части

, а через

— величина ошибки между предсказанием

и истинным значением

. Эта ошибка вычисляется как

— для задачи регрессии и

— для задачи классификации.

Наиболее популярная версия скользящего контроля — усреднение по пяти независимым запускам 2-кратного скользящего контроля. При таком подходе необходимо обучать алгоритм только по половине обучающей выборки (что происходит быстрее, чем обучение, например, по 9/10 от объема обучающей выборки). Во-вторых, здесь требуется всего 10 различных обучений (что гораздо меньше, чем, например, объем обучающей выборки

при разбиении выборки на

частей).

Настройка параметра регуляризации с помощью скользящего контроля производится следующим образом. Выбирается набор возможных значений

, например,

. Для каждого из этих значений вычисляется величина ошибки скользящего контроля (например, с помощью усреднения по пяти запускам 2-кратного скользящего контроля). В результате выбирается такое значение

, для которого величина ошибки является наименьшей. В том случае, если требуется настроить два параметра, например

и

в радиальных базисных функциях, то выбирается двухмерная сетка значений параметров и находится та пара, для которой ошибка на скользящем контроле является наименьшей.

Схема решения задач классификации/регрессии

В простейшем случае для решения задачи классификации/регрессии имеющаяся в распоряжении выборка разбивается на три подвыборки: обучающую, валидационную и тестовую. Сначала выбирается некоторая модель алгоритмов, например, линейная регрессия с полиномиальными базисными функциями. По обучающей выборке в скользящем контроле настраиваются все структурные параметры выбранной модели (для линейной регрессии с полиномиальными базисными функциями в качестве таковых выступают коэффициент регуляризации и степень полинома). Затем с выбранными значениями структурных параметров производится обучение модели алгоритмов по обучающей выборке. Полученный алгоритм тестируется на обучающей и валидационной выборке. В том случае, если значения обеих ошибок значимо отличаются друг от друга (следовательно, есть переобучение) или их значения близки между собой и достаточно большие (значит, есть недообучение), то выбранная модель алгоритмов признается неудачной и выбирается другая модель алгоритмов (более простая, если ранее было обнаружено переобучение, или более сложная, если ранее было обнаружено недообучение). После того, как удастся найти хорошую модель алгоритмов (у которой нет переобучения и недообучения), обучающая и валидационная выборка объединяются между собой и используются в качестве обучающей для настройки структурных параметров по скользящему контролю и последующего обучения в найденной хорошей модели алгоритмов. Затем полученный алгоритм тестируется на объединенной обучающей и тестовой выборке. Если обе ошибки близки между собой и достаточно маленькие по значению, то такой алгоритм признается оптимальным для решения задачи классификации/регрессии.

Зачастую имеющаяся в распоряжении выборка прецедентов является небольшой по объему и поэтому не может быть разбита на три достаточно репрезентативные подвыборки. В этом случае выборка разбивается только на обучающую и валидационную, и найденная по описанной выше схеме наилучшая модель алгоритмов не тестируется на отдельной тестовой выборке. Такой подход является менее корректным по сравнению с предыдущим, т.к. мерой качества алгоритма здесь выступает величина, которая подвергалась оптимизации на имеющихся данных. Поэтому здесь возможен эффект переобучения на уровне моделей алгоритмов. Тем не менее, во многих практических ситуациях данная схема дает вполне приемлемый результат.

Формулировка задания

Для выполнения задания необходимо выполнить следующие пункты:

| 1. Реализовать процедуру обучения/тестирования/подбора структурных параметров линейной регрессии по описанному ниже прототипу; |

| 2. Продемонстрировать на модельных данных для линейной регрессии эффект переобучения (маленькая ошибка на обучении, большая ошибка на тесте), эффект недообучения (ошибки на обучении и тесте близки между собой и большие по величине) и ситуацию нормальной работы (ошибки на обучении и тесте близки между собой и маленькие по величине); |

| 3. Решить с помощью линейной регрессии практическую задачу прогноза предела прочности бетона (описание задачи см. ниже); |

| 4. Вывести и вставить в отчет формулы для градиента и гессиана функционала |

| 5. Реализовать процедуру обучения/тестирования/подбора структурных параметров логистической регрессии по описанному ниже прототипу; |

| 6. Продемонстрировать на модельных данных для логистической регрессии эффект переобучения (маленькая ошибка на обучении, большая ошибка на тесте), эффект недообучения (ошибки на обучении и тесте близки между собой и большие по величине) и ситуацию нормальной работы (ошибки на обучении и тесте близки между собой и маленькие по величине); |

| 7. Решить с помощью логистической регрессии практическую задачу определения района происхождения вина по данным его химического анализа (описание задачи см. ниже); |

| 8. Составить отчет в формате PDF обо всех проведенных исследованиях; данный отчет должен содержать необходимые графики и описание экспериментов, выводы необходимых формул, описание полученных результатов решения практических задач, общие выводы по исследованию. |

Для выполнения задания на оценку «удовлетворительно» достаточно реализовать только пункты 4–8 без семейства полиномиальных базисных функций. Для выполнения задания на оценку «хорошо» и «отлично» необходимо выполнить все пункты задания.

Спецификация реализуемых функций

Рекомендуемая среда для выполнения задания — MATLAB. При выполнении задания в среде MATLAB необходимые алгоритмы должны быть реализованы по прототипам, указанным ниже. В случае использования других сред для выполнения задания, реализуемые функции должны соответствовать прототипам, описанным ниже. Например, при программировании на языке C набор параметров для обучения должен задаваться в текстовом файле, при этом список параметров и их возможные значения следует брать из прототипов ниже.

| Обучение линейной регрессии | |||||||||

|---|---|---|---|---|---|---|---|---|---|

| a = linreg_train(X, t, options) | |||||||||

| ВХОД | |||||||||

| |||||||||

| ВЫХОД | |||||||||

|

Обратите внимание: параметры N и M определяются неявно по размеру соответствующих элементов.

| Тестирование линейной регрессии | |||

|---|---|---|---|

| [Outputs, ErrorRate] = linreg_test(a, X, t) | |||

| ВХОД | |||

| |||

| ВЫХОД | |||

|

Прототип функции обучения логистической регрессии logreg_train целиком повторяет прототип linreg_train. При этом вектор меток класса должен содержать значения только 1 и 2.

| Тестирование логистической регрессии | |||

|---|---|---|---|

| [Outputs, Answers, ErrorRate] = logreg_test(a, X, t) | |||

| ВХОД | |||

| |||

| ВЫХОД | |||

|

Рекомендации по выполнению задания

Описание практических задач

Процедура сдачи задания

Оформление задания

Необходимо в срок до 1 сентября 2011 прислать выполненный вариант задания письмом по адресу bayesml@gmail.com с темой «Задание СФ, ФИО, номер группы». Убедительная просьба присылать выполненное задание только один раз с окончательным вариантом. Новые версии будут рассматриваться только в самом крайнем случае. Также убедительная просьба строго придерживаться заданной выше спецификации реализуемых функций. Очень трудно проверять большое количество заданий, если у каждого будет свой формат реализации.

Письмо должно содержать:

- PDF-файл с описанием проведенных исследований (отчет должен включать в себя описание выполнения каждого пункта задания с приведением соответствующих графиков, изображений, чисел)

- Файлы linreg_train.m, linreg_test.m, logreg_train.m, logreg_test.m или аналогичные им исполняемые файлы

- Набор вспомогательных файлов при необходимости

Защита задания

После сдачи выполненного задания и его проверки необходимо будет защитить свое задание. В том случае, если в какой-то части выполненного задания будет обнаружен плагиат с заданием другого студента, то задание не будет засчитано для обоих студентов! Защита задания будет осуществляться с помощью видео-чата для студентов СФ и во время осенних пересдач для московских студентов. Студенту будет предложен ряд вопросов по присланному коду и проведенным исследованиям. Кроме того, возможны задания по небольшой модификации кода в режиме онлайн.