Нормализация ДНК-микрочипов

Материал из MachineLearning.

(→Методы нормализации) |

м (→Парадигмы нормализации) |

||

| Строка 2: | Строка 2: | ||

== Парадигмы нормализации == | == Парадигмы нормализации == | ||

| - | Нормализация на | + | |

| + | Нормализация на гены домашнего хозяйства, нормализация на все гены, нормализация на стабильные гены<ref name="lvs">Calza S, Valentini D, Pawitan Y. Normalization of oligonucleotide arrays based on the least-variant set of genes. BMC bioinformatics. 2008;9(140). http://www.ncbi.nlm.nih.gov/pmc/articles/PMC2324100/.</ref> | ||

== Методы нормализации == | == Методы нормализации == | ||

Версия 07:17, 8 мая 2010

Нормализация - важный этап предобработки ДНК-микрочипов, позволяющий сделать несколько рассматриваемых в эксперименте чипов пригодными к сравнению между собой. Основная цель анализа на этом этапе - исключить влияние систематических небиологических различий между микрочипами. Источников таких различий множество: вариации эффективности обратной транскрипции, маркировки красителями, гибридизации, физические различия между чипами (повреждения, царапины), небольшие различия в концентрации реагентов, вариация лабораторных условий.

Содержание |

Парадигмы нормализации

Нормализация на гены домашнего хозяйства, нормализация на все гены, нормализация на стабильные гены[1]

Методы нормализации

Масштабирование

Один из ДНК-микрочипов выбирается в качестве базового, затем все остальные масштабируются таким образом, чтобы их средняя интенсивность равнялась средней интенсивности базового (этот способ эквивалентен построению линейной регрессии каждого чипа на базовый и последующей нормализации при помощи регрессионной функции).

Для большей устойчивости можно использовать усечённое среднее. Так, в стандартном программном обеспечении производителя микрочипов Affymetrix перед подсчётом среднего отбрасываются по 2% наибольших и наименьших значений интенсивности. Другая модификация — масштабирование к средней интенсивности не по всему базовому чипу, а по каждому подмножеству его проб, соответствующих одному гену.

Affymetrix предлагает использовать масштабирование на последнем этапе предобработки, применяя его непосредственно к матрицам экспрессии, однако, возможно и применение к матрицам интенсивности.

Схема выполнения масштабирования

Выбрать столбецматрицы

в качестве базового. Вычислить (усечённое) среднее

по столбцу

Для всех остальных столбцов матрицы

: вычислить (усечённое) среднее

по столбцу

; вычислить

; каждый элемент столбца

умножить на

Нелинейные методы

Предложено большое количество нелинейных способов нормализации данных, использующих различные настраиваемые функции, заменяющие линейную регрессию из предыдущего примера. Среди таких функций cross-validated splines[1], running median lines[1], loess smoothers[1], и т.д. В типичном случае нелинейная нормализация проводится по множеству рангово-инвариантных проб, то есть, проб, имеющих один и тот же ранг во всех микрочипах.

Схема выполнения нелинейной нормализации

Выбрать столбецматрицы

в качестве базового. Для всех столбцов

матрицы настроить параметры нелинейной функции

, отображающей столбец

на столбец

. Пусть

- полученное отображение. Нормализованные значения в столбце

определяются как

.)

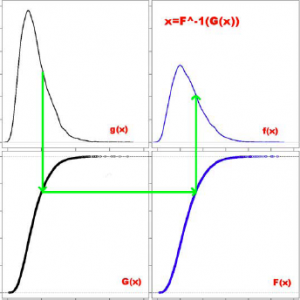

Квантильная нормализация

Цель квантильной нормализации - сделать одинаковыми эмпирические распределения интенсивностей всех микрочипов. Для этого используется преобразование вида где

- эмпирическое распределение интенсивностей каждого чипа,

- эмпирическое распределение интенсивностей усреднённого чипа. Можно модифицировать метод, оценивая

и

более гладкими функциями. Однако, для данных большой размерности на практике достаточно и грубой оценки.

Приводимый метод квантильной нормализации - не единственный способ нормализации, основанный на квантилях. Описан метод, основанный на построении сплайнов по множеству квантилей[1], непараметрический метод присваивания одного и того же распределения каждому микрочипу[1] и др.

Схема выполнения квантильной нормализации

Имеямикрочипов размерности

, построить матрицу

размерности

, где в каждом столбце находятся значения интенсивности по каждому чипу. Отсортировать все столбцы

независимо друг от друга, сформировав матрицу

Взять среднее по каждой строке матрицы

и создать

- матрицу той же размерности, что и

, в каждой строке которой все значения равны среднему по строке

Получить матрицу

, переставив значения в столбцах

в том порядке, в каком они стояли в исходной матрице

Циклическая нормализация при помощи локальной регрессии (cyclic loess)

Данный метод основан на многократном применении локальной регрессии (англ. LOWESS, LOESS) к парам ДНК-микрочипов. Процедура перебирает все попарные комбинации микрочипов, повторяя процесс нормализации до достижения сходимости. Одним из её недостатков является необходимость применений локальной регресиии, хотя, обычно требуется всего один или два шага цикла. Значительно уменьшить время вычисления можно, используя подмножество данных для построения регрессионной зависимости.

Ниже приведён алгоритм циклической loess-нормализации. Индексы и

соответствуют номерам микрочипов, а индекс

- номеру пробы или подмножества проб, соответствующих одному гену.

Схема выполнения циклической loess-нормализации

Сформировать матрицуразмерности

где столбцы соответствуют различным микрочипам, а строки - пробам или подмножествам проб. Выполнить логарифмирование данных:

Повторять Цикл по

от

до

Цикл по

от

до

Цикл по

от

до

Вычислить

и

Конец цикла по

Построить локальную регрессию

на

, обозначим полученную зависимость

Цикл по

от

до

)

/n)

и

Конец цикла по

Конец цикла по

Конец цикла по

до достижения сходимости или максимального числа итераций. Выполнить преобразование к исходной шкале:

.)