Оценка сложности регрессионных моделей (пример)

Материал из MachineLearning.

Задача восстановления регрессии является частным случаем задачи обучения по прецедентам. При выборе модели, как и для всех задач обучения по прецедентам, возможны проблемы недообучения и переобучения.

В случае недообучения, модель недостаточно сложна для описания данных с требуемой точностью. А в случае переобучения, возникающего при избыточной сложности моделей, средняя ошибка на тестовой выборке существенно выше,чем на обучающей выборке.

Таким образом, для каждой задачи существует оптимальная сложность модели.

Содержание |

Способы оценки сложности регрессионных моделей

Существуют различные способы оценки сложности, используемые при выборе регрессионных моделей. Одним из них является критерий Акаике (AIC), основанный на принципе Оккама, а также тесно связанный с ним Байесовский информационный критерий (BIC). В теории Вапника-Червоненкиса одним из ключевых понятий является размерность Вапника-Червоненкиса, которая также является характеристикой сложности семейства алгоритмов.

Поскольку задача описания данных формально эквивалентна кодированию, то сложность модели можно оценивать также как длину требуемого для её описания кода. На этом основан принцип минимальной длинны описания (MDL)[1].

Функция правдоподобия (достоверность) в некотором роде тоже можно рассматривать как оценку сложности модели[1].

Постановка задачи

Рассматривается линейная регрессионная модель

Предполагается, что случайная величина

распределена

нормально с нулевым матожиданием и

фиксированной дисперсией , которая не зависит от переменных

.

При таких предположениях параметры

регрессионной модели вычисляются с помощью

метода наименьших квадратов.

Будем рассматривать одномерные выборки. Обозначим порождаемые признаки (свободные переменные).

Множество порождающих функций

В качестве модели, описывающей отношение между свободными переменными и зависимой переменной

будем использовать полином Колмогорова-Габора

Где вектор коэффициентов

Используя модельные данные, мы будем строить кривые зависимости AIC, BIC, размерности Вапника-Червоненкиса, длинны описания(MDL), функции правдоподобия (достоверности), а также количества хорошо определяемых параметров от количества мономов полинома Колмлгорова-Габора.

Вычисление AIC и BIC для линейной регрессионной модели

Пусть:

- наблюдаемая часть выборки, где каждый объект характеризуется набором параметров

.

;

— дисперсия остатков;

В случае линейной регрессионной модели критерий BIC

выражается через SSE (Sum of Squared Errors) - сумму квадратов остатков - и - дисперсия остатков.

А критерий Акаике через SSE. - число параметров модели

Лучшая модель соответствует минимальному значению критерия.

Вычисление размерности Вапника-Червоненкиса

Для задач регрессии обычно размерность Вапника-Червоненкиса принимают равной количеству параметров.

Вычисление функции правдоподобия и количества хорошо определяемых параметров

Для оценки сложности используется логарифм функции правдоподобия(evidence)

Где функция регрессионных невязок:

Функция ошибки:

Матрица Гессе функции ошибок

Представим

части Гессеана, не зависящие от

Количество хорошо определяемых параметров:

Численный эксперимент

Генерация модельных данных.

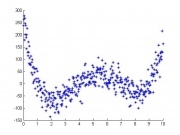

Функция - полином 4й степени. Случайная составляющая нормально распределена.

x=1:.025:10; y=(x-3).*(x-4).*(x-7).*(x-9)+15.*randn(size(x)); scatter(x,y,'*') % запишем x и y в виде столбцов x=x'; y=y';

Порождение признаков

%Построим матрицу подстановок (В модели будем использовать полином Колмогорова-Габора до третьей %степени от попрождающих функций) Ap=[ x.^0,x.^0.5,x,x.^1.5,x.^2, tan(x),log(x),exp(x) ]; %Полином первой степени %добавим столбцы, соответствующие полиному второй степени for i=5:8, for j=2:5, Ap(:,size(Ap,2)+1)=Ap(:,i).*Ap(:,j); end end for i=6:8, for j=i:8, Ap(:,size(Ap,2)+1)=Ap(:,i).*Ap(:,j); end end %добавим столбцы, соответствующие третьей степени полинома %Колмогорова-Габора for i=12:30, for j=2:5, Ap(:,size(Ap,2)+1)=Ap(:,i).*Ap(:,j); end end for i=6:8, for j=i:8, for k=j:8, Ap(:,size(Ap,2)+1)=Ap(:,i).*Ap(:,j).*Ap(:,k); end end end

Литература

David J.C. MacKay. Information Theory, Inference, and Learning Algorithms