Профиль компактности

Материал из MachineLearning.

|

Профиль компактности выборки в метрических алгоритмах классификации — функция , выражающая долю объектов выборки, для которых правильный ответ не совпадает с правильным ответом на

-м соседе.

Определения

Рассматривается задача классификации.

Имеется множество объектов и множество имён классов

.

Задана обучающая выборка пар «объект—ответ»

.

Пусть на множестве объектов задана функция расстояния .

Эта функция должна быть достаточно адекватной моделью сходства объектов.

Чем меньше значение этой функции, тем более схожи объекты

.

Для произвольного объекта расположим

объекты обучающей выборки

в порядке возрастания расстояний до

:

где через обозначается элемент обучающей выборки, который является

-м соседом объекта

.

Аналогичное обозначение введём и для ответа на

-м соседе:

.

Каждый объект

порождает свою перенумерацию выборки.

Рассматривается метод ближайшего соседа, который относит классифицируемый объект к тому классу, которому принадлежит ближайший к

объект обучающей выборки:

Определение.

Профиль компактности выборки есть функция

Профиль компактности является формальным выражением гипотезы компактности — предположения о том, что схожие объекты гораздо чаще лежат в одном классе, чем в разных. Чем проще задача, то есть чем чаще близкие объекты оказываются в одном классе, тем сильнее «прижимается к нулю» начальный участок профиля. В сложных задачах или при неудачном выборе функции расстояния ближайшие объекты практически не несут информации о классах, и профиль вырождается в константу, близкую к 0.5.

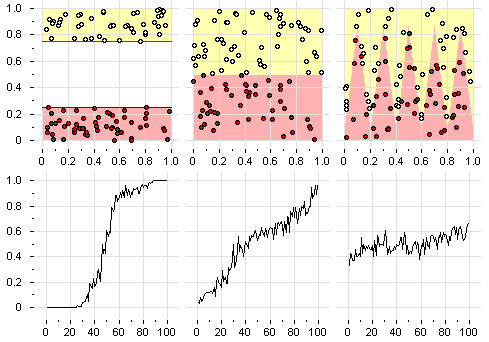

На рисунке показаны профили компактности для серии плоских модельных задач классификации с двумя классами. Чем ниже проходит начальный участок профиля, тем выше обобщающая способность метода ближайшего соседа.

Связь с полным скользящем контролем

Выборка разбивается всевозможными

способами на две непересекающиеся подвыборки:

,

где

— обучающая подвыборка длины

,

— контрольная подвыборка длины

,

— номер разбиения.

Для каждого разбиения строится алгоритм

.

Функционал полного скользящего контроля (complete cross-validation, CCV)

определяется как средняя (по всем разбиениям) ошибка на контроле:

Функционал полного скользящего контроля характеризует обобщающую способность метода ближайшего соседа

Теорема. Справедлива формула для эффективного вычисления CCV через профиль компактности:

где

Комбинаторный множитель быстро убывает с ростом

.

Поэтому для минимизации функционала CCV достаточно, чтобы при малых

профиль принимал значения, близкие к нулю.

Но это и означает, что близкие объекты должны лежать преимущественно в одном классе.

Таким образом, профиль действительно является формальным выражением гипотезы компактности.

Отбор опорных объектов (столпов) путём минимизации CCV

В статье [Воронцов, Колосков] процедура оптимизации профиля компактности положена в основу нового алгоритма выделения опорных объектов. В отличие от алгоритма СТОЛП, основанного на «жадной» стратегии последовательного добавления опорных объектов [Загоруйко], данный алгоритм работает в противоположном направлении — начиная с полной выборки, он последовательно исключает объекты. На каждом шаге выбирается тот объект, исключение которого минимизирует CCV. Оказывается, что процесс отсева объектов разбивается на две стадии. Сначала исключаются шумовые выбросы, что приводит к понижению начального (левого) участка профиля и уменьшению CCV. Затем исключаются неинформативные периферийные объекты. При этом изменяется правый участок профиля, а значение функционала практически не изменяется. Процесс останавливается, когда остаются объекты, исключение которых заметно увеличивает CCV, это и есть столпы или опорные объекты. Таким образом, возникает естественное деление обучающих объектов на шумовые, периферийные и опорные. Эксперименты показывают, что при отборе объектов по критерию CCV практически нет переобучения. В процессе отсева шумовых и периферийных объектов число ошибок на независимой тестовой выборке изменяется практически синхронно со значением CCV, вычисляемым по обучающей выборке.

См. также

Литература

- Воронцов К. В. Комбинаторный подход к оценке качества обучаемых алгоритмов // Математические вопросы кибернетики / Под ред. О. Б. Лупанов. — М.: Физматлит, 2004. — Т. 13. — С. 5–36.

- Воронцов К. В., Колосков А. О. Профили компактности и выделение опорных объектов в метрических алгоритмах классификации // Искусственный Интеллект. — 2006. — С. 30–33.

- Загоруйко Н. Г. Прикладные методы анализа данных и знаний. — Новосибирск: ИМ СО РАН, 1999.

- Mullin M., Sukthankar R. Complete cross-validation for nearest neighbor classifiers // Proceedings of International Conference on Machine Learning. — 2000.