Сеть радиальных базисных функций

Материал из MachineLearning.

(→Решение задачи) |

|||

| Строка 19: | Строка 19: | ||

== Решение задачи == | == Решение задачи == | ||

Пусть <tex> |Y| = M</tex> - число классов, каждый класс <tex>y \in Y</tex> имеет свою плотность | Пусть <tex> |Y| = M</tex> - число классов, каждый класс <tex>y \in Y</tex> имеет свою плотность | ||

| - | распределения <tex>p_y(x)</tex> и представлен частью выборки <tex>X ^l _y = \{(x_i, y_i) \in X ^l | y_i = y \}</tex>. <br /> <br /> | + | распределения <tex>p_y(x)</tex> и представлен частью [[выборка|выборки]] <tex>X ^l _y = \{(x_i, y_i) \in X ^l | y_i = y \}</tex>. <br /> <br /> |

===Гипотеза=== | ===Гипотеза=== | ||

Плотности классов <tex>p_y(x), y \in Y</tex> , представимы в виде | Плотности классов <tex>p_y(x), y \in Y</tex> , представимы в виде | ||

Версия 17:33, 6 января 2010

Сеть радиальных базисных функций - нейронная сеть прямого распространения сигнала, которая содержит промежуточный (скрытый) слой радиально симметричных нейронов. Такой нейрон преобразовывает расстояние от данного входного вектора до соответствующего ему "центра" по некоторому нелинейному закону (обычно функция Гаусса)[1]. В данной статье мы рассмотрим применение этой нейронной сети к решению задачи классификации с помощью восстановления смесей распределений (частный случай ЕМ-алгоритма)

Содержание |

Понятие радиальной функции

Радиальная функция — это функция , зависящая только от расстояния между x и фиксированной точ-

кой пространства X.

Для определения наших радиальных функий введем метрику:

Нормальное распределение (гауссиан) с диагональной матрицей ковариации

можно записать в виде

где — нормировочный множитель,

— взвешенная евклидова метрика в n-мерном пространстве X:

,

.

Чем меньше расстояние , тем выше значение плотности в точке x. Поэтому плотность

можно рассматривать как функцию близости вектора x к фиксированному центру

.

Постановка задачи

Построить алгоритм, который бы решал задачу классификации байесовским алгоритмом (частный случай EM-алгоритма) в предположении, что плотность распределения представима в виде смеси гауссовских распределений с диагональными матрицами ковариации.

Решение задачи

Пусть - число классов, каждый класс

имеет свою плотность

распределения

и представлен частью выборки

.

Гипотеза

Плотности классов , представимы в виде

смесей

компонент. Каждая компонента имеет n-мерную гауссовскую плотность

с параметрами

- центр,

- ковариационная матрица

:

- смесь плотностей

- плотность каждой компоненты смеси (имеет вид гауссианы)

- условия нормамировки и неотрицательности весов

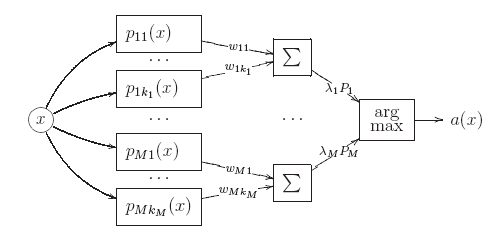

Алгоритм классификации

Запишем основную формулу байесовского классификатора

, выразив плотность каждой компоненты

через взвешенное евклидово расстояние от объекта x до центра компоненты

(другими словами - подставим в основную формулу байесовского классификатора вместо

формулы, которые мы предположили в гипотезе) :

где — нормировочные множители. Алгоритм имеет вид

нейронной сети, состоящей из трёх уровней или слоёв.

Первый слой образован гауссианами

.

На входе они принимают описание объекта x, на выходе выдают оценки близости

объекта x к центрам

, равные значениям плотностей компонент в точке x.

Второй слой состоит из M сумматоров, вычисляющих взвешенные средние этих

оценок с весами . На выходе второго слоя появляются оценки близости

объекта x каждому из классов, равные значениям плотностей классов

.

Третий слой образуется единственным блоком argmax, принимающим окончательное решение об отнесении объекта x к одному из классов.

Таким образом, при классификации объекта x оценивается его близость к каж-

дому из центров по метрике

. Объект относится к тому

классу, к чьим центрам он располагается ближе.

Описанный трёхуровневый алгоритм классификации называется сетью c радиальными базисными функциями или RBF-сетью (radial basis function network). Это одна из разновидностей нейронных сетей.

Обучение RBF-сети

Обучение сводится к восстановлению плотности каждого из классов

с помощью EM-алгоритма. Результатом обучения являются центры

и дис-

персии

компонент

. Интересно отметить, что, оценивая дисперсии,

мы фактически подбираем метрики

, с помощью которых будут вычисляться расстояния до центров

. При использовании Алгоритма, описанного в данной статье, для каждого класса определяется оптимальное число компонент смеси.[1]

Литература

См. также

Байесовский классификатор

EM-алгоритм

Нейронная сеть

| | Данная статья является непроверенным учебным заданием.

До указанного срока статья не должна редактироваться другими участниками проекта MachineLearning.ru. По его окончании любой участник вправе исправить данную статью по своему усмотрению и удалить данное предупреждение, выводимое с помощью шаблона {{Задание}}. См. также методические указания по использованию Ресурса MachineLearning.ru в учебном процессе. |